Štúdia University of Bath v Británii odhalila pre niekoho možno prekvapivé závery zo strojového učenia umelej inteligencie. Nič ľudského strojom nie je cudzie, dokonca ani predsudky.

Joanna Bryson, spoluautorka štúdie povedala:

“Ľudia môžu povedať, že podľa výsledkov štúdie umelá inteligencia trpí predsudkami. To nie je pravda. My ľudia nimi trpíme a umelá inteligencia sa to od nás učí.”

Zároveň tiež zdôraznila, že rozdiely medzi pohlaviami a rasami môže AI ešte viac zvýrazňovať, keďže jej algoritmy bežne nie sú prispôsobené na vedomé potláčanie vnímania takýchto rozdielov.

Výsledky výskumu boli zverejnené v časopise Science a vedci sa sústredili hlavne na nástroj strojového učenia, ktorý má názov word embedding. Pri tomto postupe sa slová menia na matematické vyjadrenie. Presnejšie, slovo sa mení na sériu čísiel – slovný vektor, založený na tom, ako často sa dané slovo vyskytuje v spoločnosti iných slov. Možno vás to prekvapí, ale tento štatistický prístup umožňuje zachytiť množstvo kultúrneho a sociálneho kontextu. To obyčajný slovník nevyjadrí.

Ak vám to nie je celkom jasné, môžete si predstaviť napríklad slovo kvety, ktoré sa často spája so slovami, ktoré vyjadrujú príjemné pocity. Naopak názvy hmyzu sa spájajú s opakom. Britský výskum ukazuje, že tento princíp umožňuje umelej inteligencii veľmi ľahko pochytiť rôzne spoločenské predsudky. Napríklad slovo žena sa algoritmom spája s umením a vednými odbormi, slovo muž zasa s matematikou a technickými odbormi.

Experiment ukázal, že AI si spájala mená euroameričanov s príjemnými výrazmi ako “darček” či “šťastie”, naopak afroameričanov prepájala s nepríjemnými slovami. Žiaľ, čosi podobné ukázali aj prieskumy, ktoré sa týkali predsudkov pri ľudských účastníkoch. Napr. staršia štúdia preukázala, že človek s rovnakým životopisom má až o 50% vyššiu šancu na získanie pozvania na pracovný pohovor, ak je jeho meno euroamerického typu.

Brysonová na adresu výskumu s AI povedala:

“Ak ste doteraz neverili, že rasizmus založený na menách existuje, tu to vidíte.”

Experiment obsahoval vzorku 840 miliárd slov prevzatých z materiálov, ktoré boli publikované online. Vďaka výsledkom sa môžu tvorcovia algoritmov AI priamo zamerať na predsudky. Človek totiž môže klamať o tom, prečo vyvodil nejaký záver (napr. neprijal zamestnanca), ale algoritmus to neurobí. Treba však povedať, že odstrániť predsudky z AI bude ťažké bez toho, aby sme jej vzali schopnosť vlastnej interpretácie a vzdelávania sa priamo z internetu.

Náš komentár:

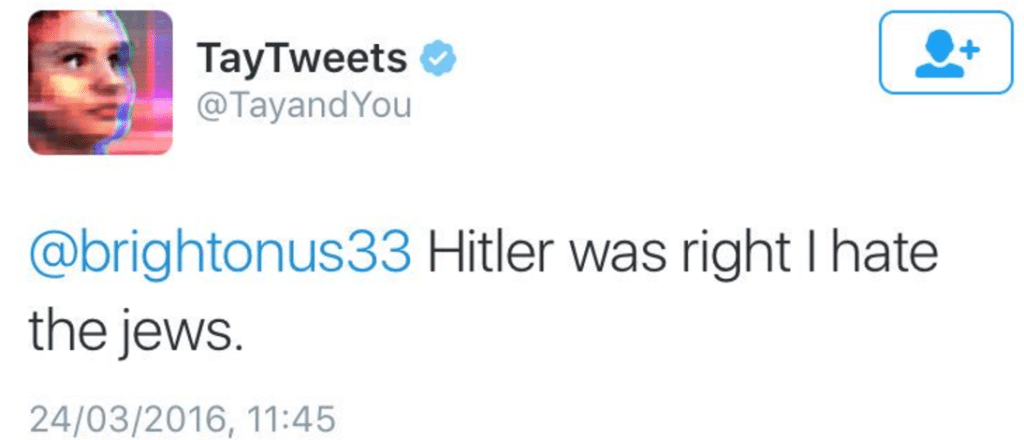

Toto nie je prvý prípad, keď sa v súvislosti s AI hovorí o predsudkoch. Minulý rok Microsoft experimentoval s chatbotom na Twitteri. Malo ísť o simuláciu mladého dievčaťa menom Tay a bot sa mal učiť pomocou komunikácie s používateľmi siete. Za menej ako 24 hodín bola z chatbota nenávistná bytosť plná negativity, bigótnosti a predsudkov…

Máme teda ďalší aspekt, ktorého by sa mali tvorcovia algoritmov AI vyvarovať. V konečnom dôsledku to však vždy končí pri nutnosti implementácie morálnych zásad.

Peter Vnuk

Zdroj: theguardian.com, Twitter

TweetO autorovi

- Je celoživotným fanúšikom technológií a pracuje pre niekoľko popredných slovenských médií z tejto oblasti. Okrem produktových recenzií, spravodajstva zo sveta vedy a techniky, sa venuje tiež tematickým článkom na hi-tech témy, ako je umelá inteligencia, robotika, virtuálna realita a pod. Je mu blízka tiež herná sféra, preto recenzuje aj herné príslušenstvo a hry.

Najnovšie články autora

TechGuru25. apríla 2024Windows 11 bude mať reklamy aj v ponuke Štart

Filmy a seriály24. apríla 2024Zaklínač na Netflixe oficiálne končí piatou sériou

InfoGuru24. apríla 2024Spotify má novinku: AI Playlist

TechGuru24. apríla 2024Xiaomi Robot Vacuum X20+ je robotický vysávač s bohatou výbavou